💥 change readme

This commit is contained in:

parent

ffa4e491ea

commit

a4138aec1a

14

.github/workflows/private-docker.yml

vendored

14

.github/workflows/private-docker.yml

vendored

@ -3,9 +3,10 @@ name: one-api docker image

|

||||

on:

|

||||

push:

|

||||

branches:

|

||||

- private

|

||||

- new

|

||||

|

||||

- main

|

||||

tags:

|

||||

- "v*"

|

||||

|

||||

env:

|

||||

# github.repository as <account>/<repo>

|

||||

IMAGE_NAME: martialbe/one-api

|

||||

@ -43,8 +44,9 @@ jobs:

|

||||

images: ghcr.io/${{ env.IMAGE_NAME }}

|

||||

# generate Docker tags based on the following events/attributes

|

||||

tags: |

|

||||

type=raw,value=latest,enable=${{ github.ref == 'refs/heads/private' }}

|

||||

type=raw,value=new,enable=${{ github.ref == 'refs/heads/new' }}

|

||||

type=raw,value=dev,enable=${{ github.ref == 'refs/heads/main' }}

|

||||

type=raw,value=latest,enable=${{ startsWith(github.ref, 'refs/tags/') }}

|

||||

type=pep440,pattern={{raw}},enable=${{ startsWith(github.ref, 'refs/tags/') }}

|

||||

|

||||

- name: Build and push

|

||||

uses: docker/build-push-action@v4

|

||||

@ -57,4 +59,4 @@ jobs:

|

||||

tags: ${{ steps.meta.outputs.tags }}

|

||||

labels: ${{ steps.meta.outputs.labels }}

|

||||

cache-from: type=gha

|

||||

cache-to: type=gha,mode=max

|

||||

cache-to: type=gha,mode=max

|

||||

|

||||

128

README.en.md

128

README.en.md

@ -10,28 +10,30 @@

|

||||

|

||||

# One API

|

||||

|

||||

_This project is a derivative of [one-api](https://github.com/songquanpeng/one-api), where the main focus has been on modularizing the module code from the original project and modifying the frontend interface. This project also adheres to the MIT License._

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/MartialBE/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/MartialBE/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/MartialBE/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/MartialBE/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

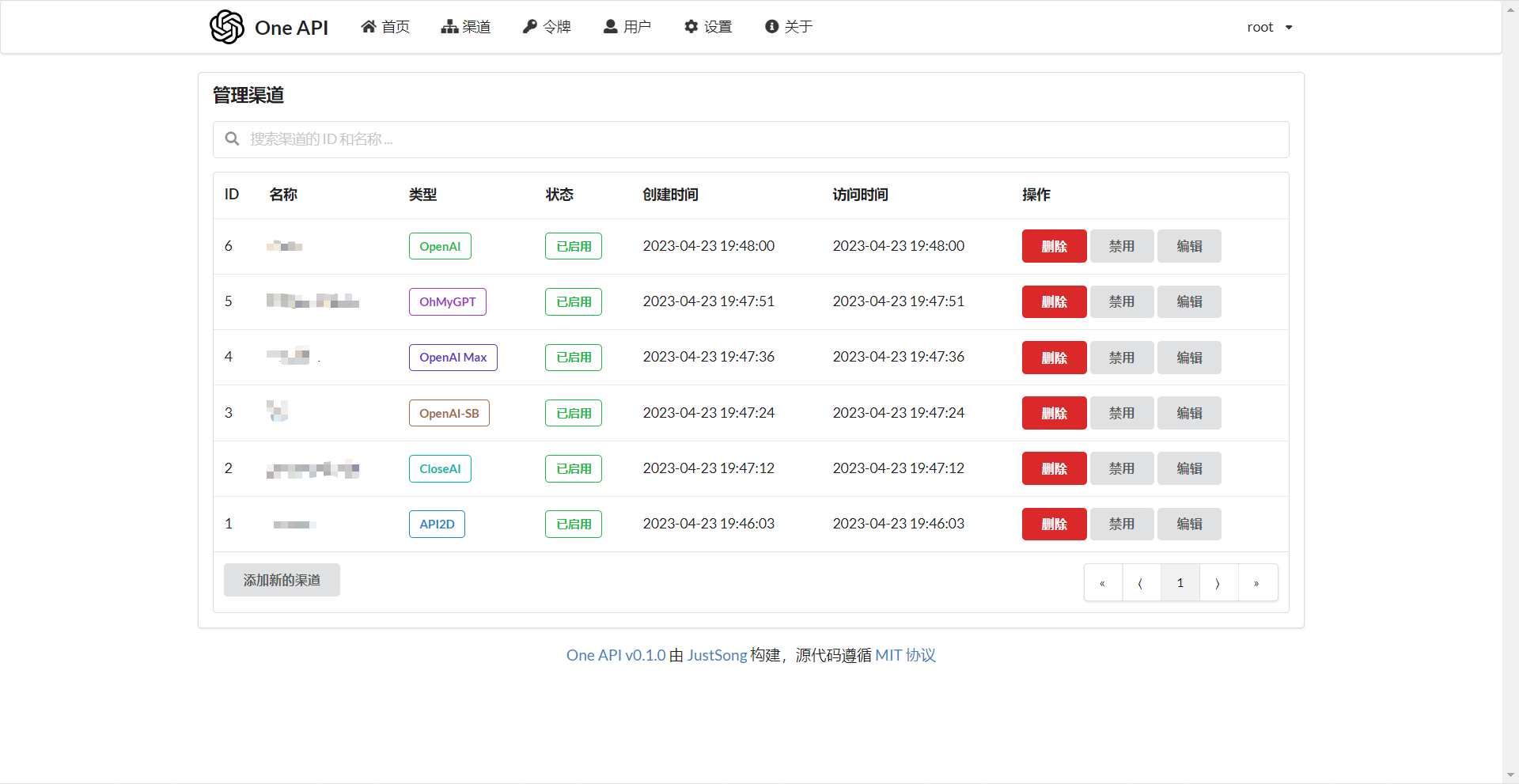

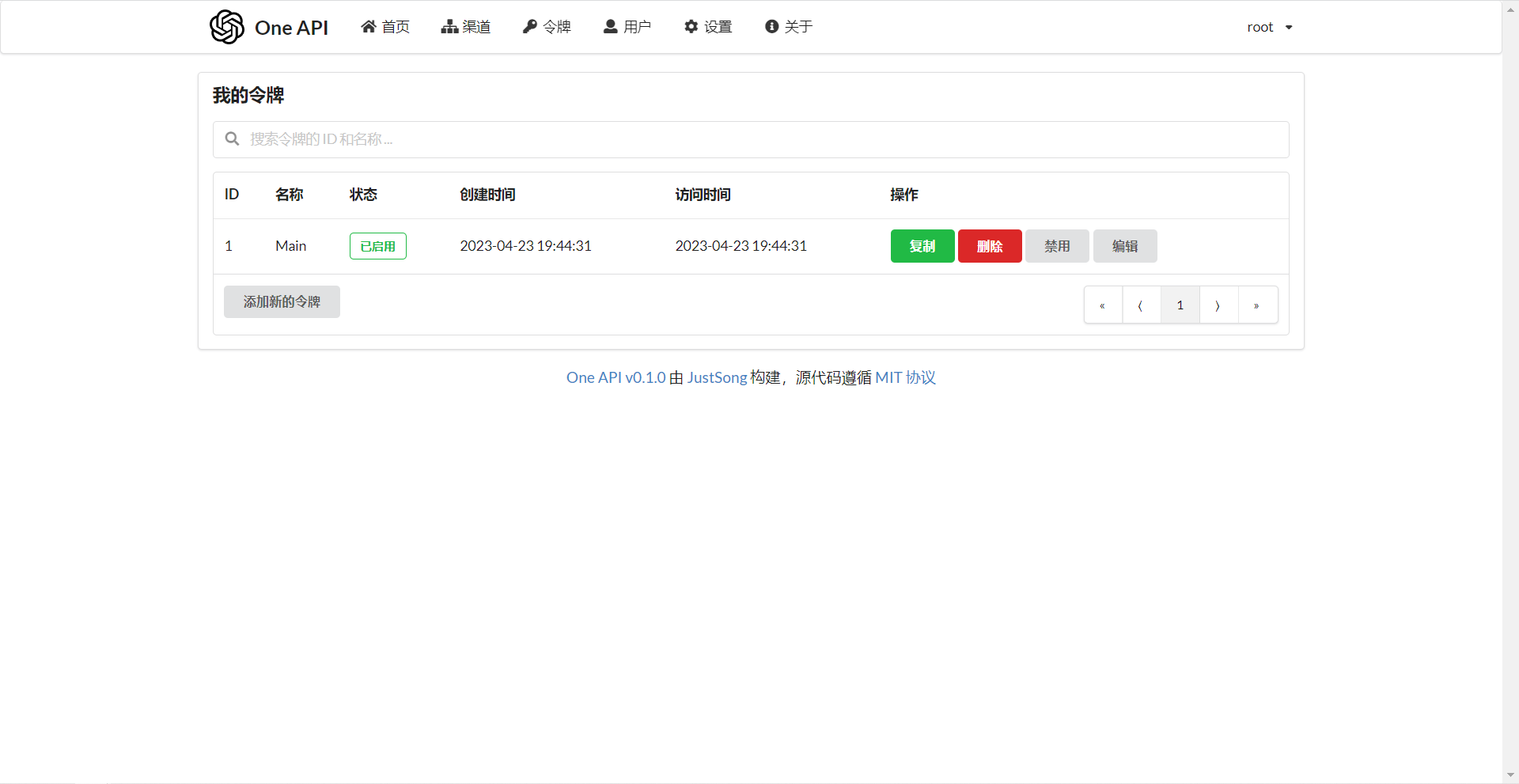

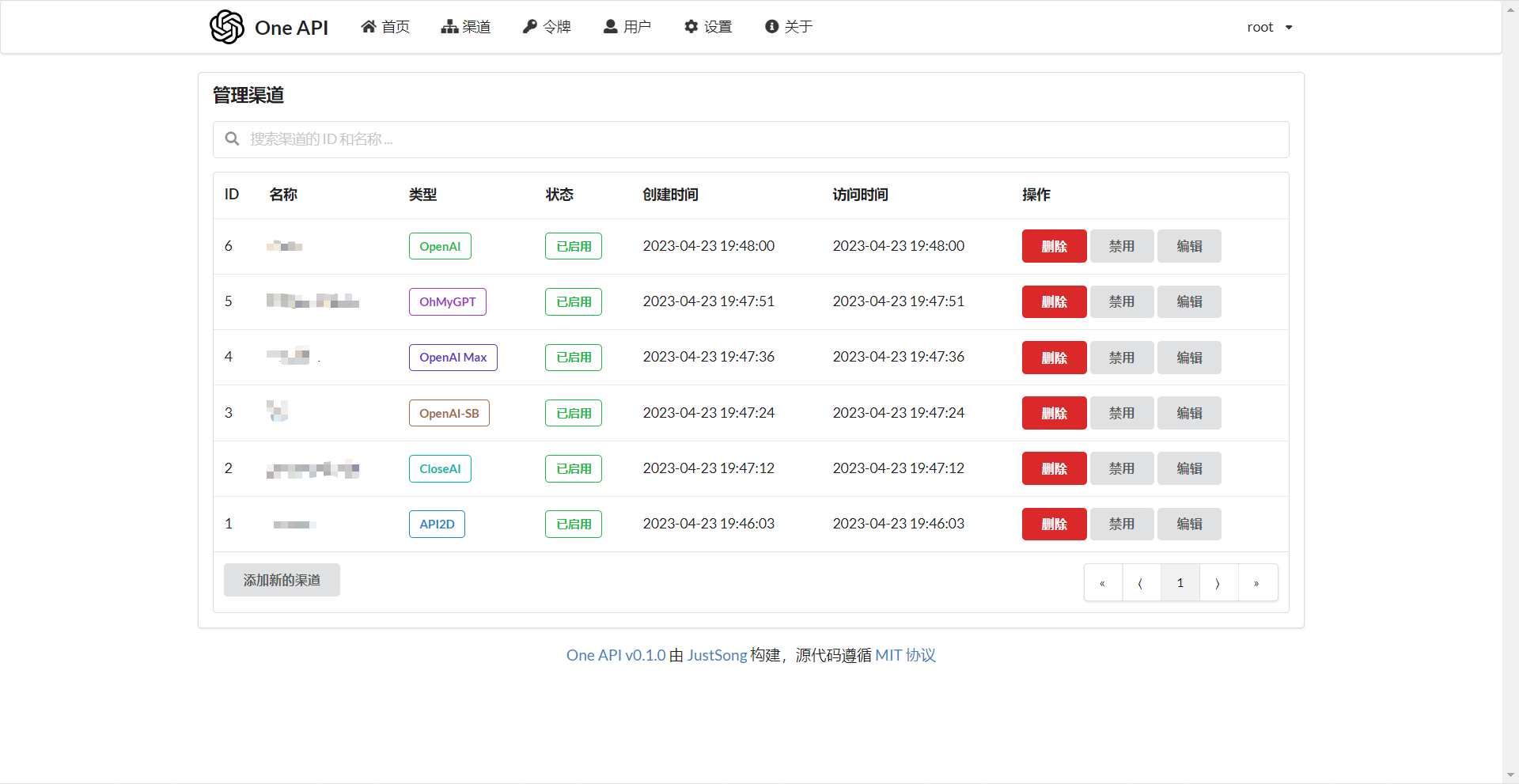

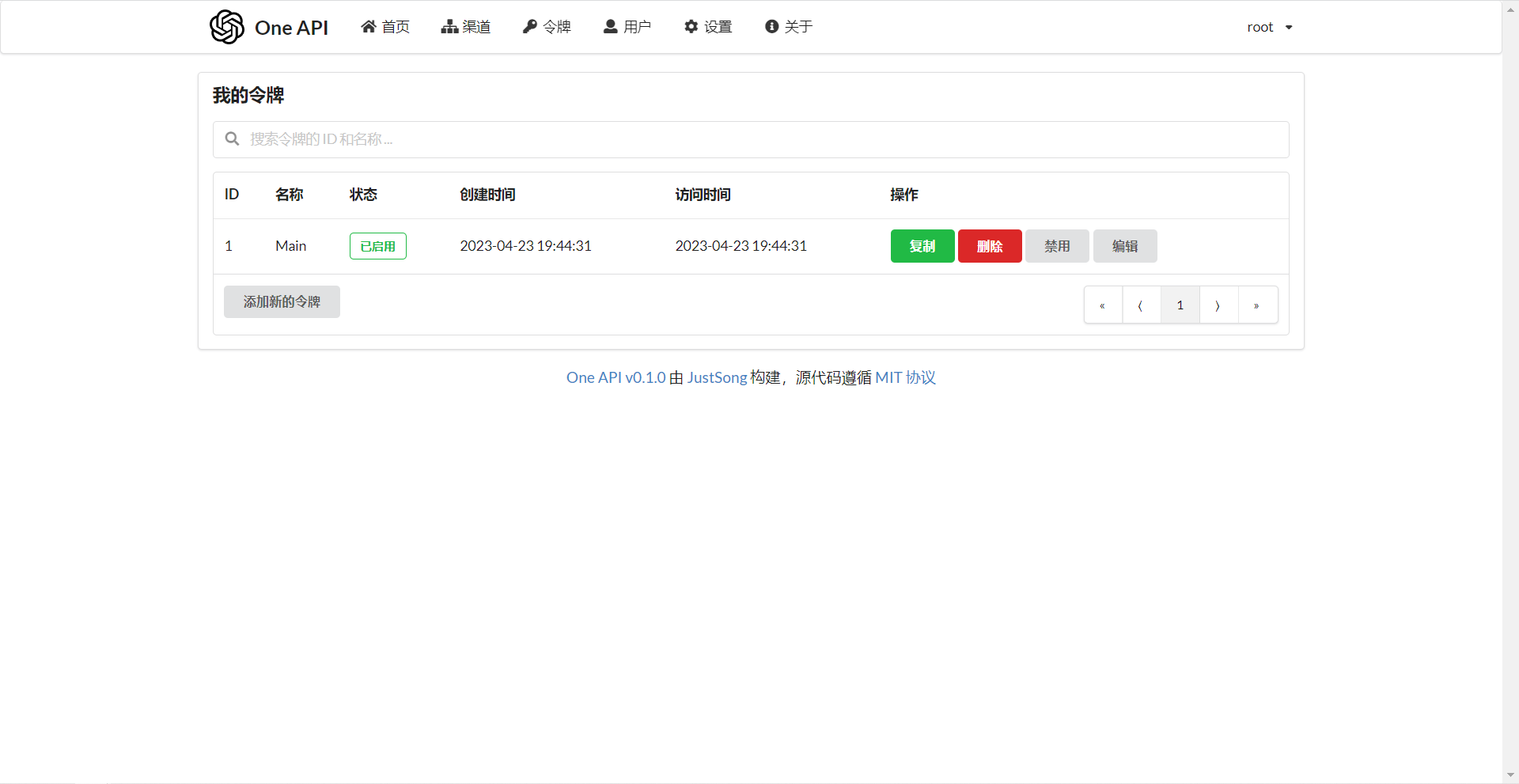

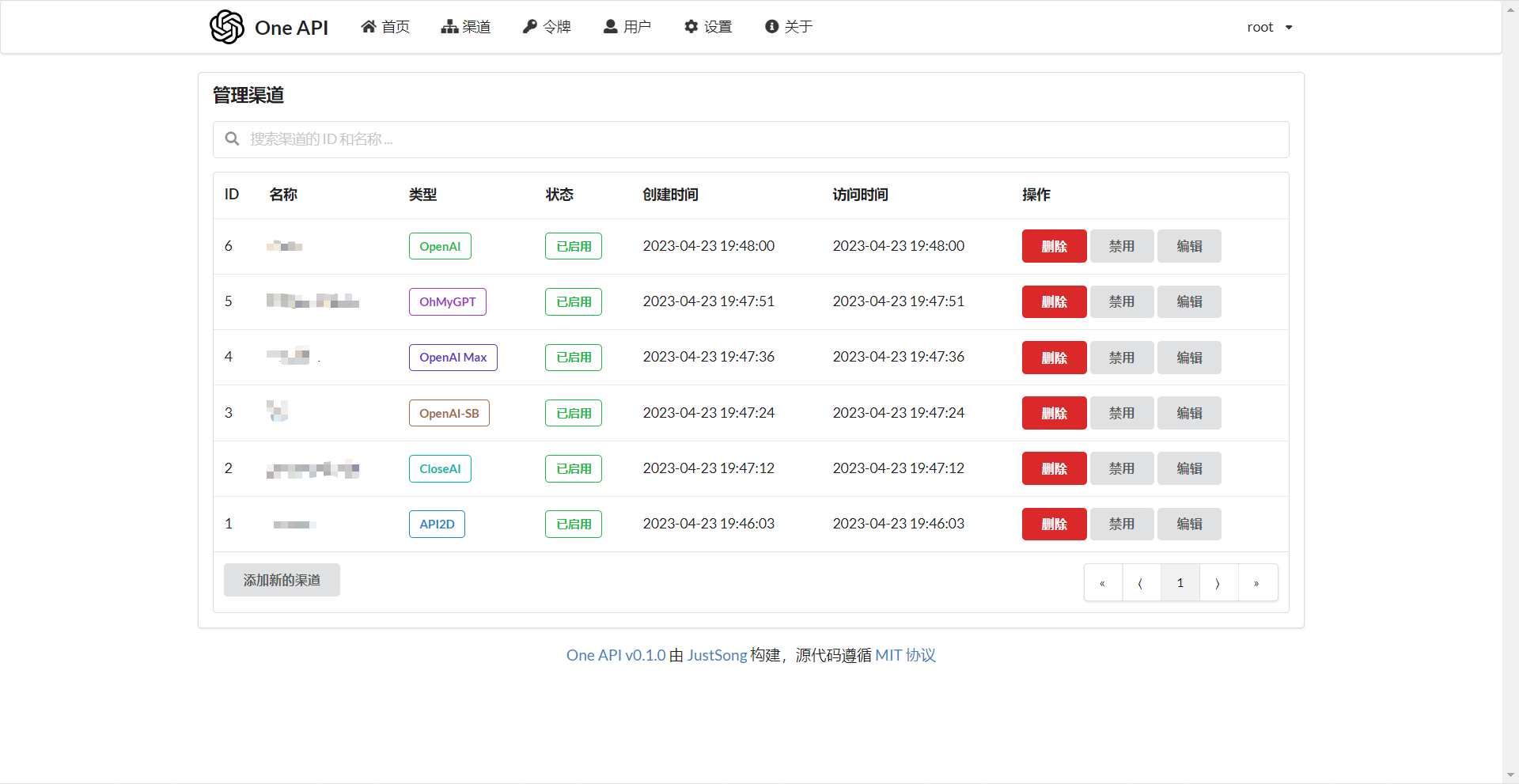

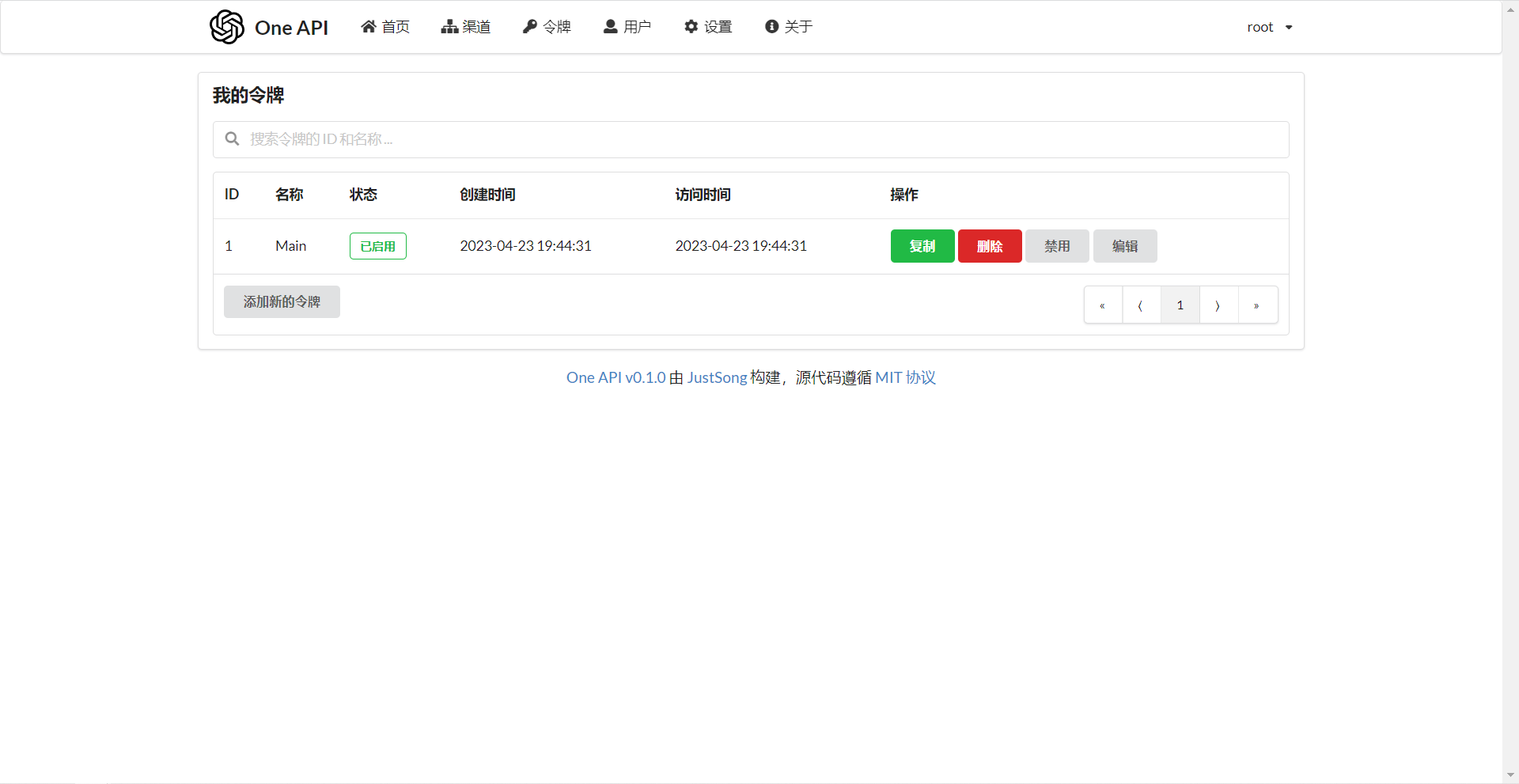

## Screenshots

|

||||

|

||||

|

||||

|

||||

|

||||

_The following is the original project description:_

|

||||

|

||||

---

|

||||

|

||||

_✨ Access all LLM through the standard OpenAI API format, easy to deploy & use ✨_

|

||||

|

||||

</div>

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/songquanpeng/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/songquanpeng/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/v/release/songquanpeng/one-api?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://hub.docker.com/repository/docker/justsong/one-api">

|

||||

<img src="https://img.shields.io/docker/pulls/justsong/one-api?color=brightgreen" alt="docker pull">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/downloads/songquanpeng/one-api/total?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/songquanpeng/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/songquanpeng/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

<p align="center">

|

||||

<a href="#deployment">Deployment Tutorial</a>

|

||||

·

|

||||

@ -57,13 +59,14 @@ _✨ Access all LLM through the standard OpenAI API format, easy to deploy & use

|

||||

> **Note**: The latest image pulled from Docker may be an `alpha` release. Specify the version manually if you require stability.

|

||||

|

||||

## Features

|

||||

|

||||

1. Support for multiple large models:

|

||||

+ [x] [OpenAI ChatGPT Series Models](https://platform.openai.com/docs/guides/gpt/chat-completions-api) (Supports [Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference))

|

||||

+ [x] [Anthropic Claude Series Models](https://anthropic.com)

|

||||

+ [x] [Google PaLM2 Series Models](https://developers.generativeai.google)

|

||||

+ [x] [Baidu Wenxin Yiyuan Series Models](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

+ [x] [Alibaba Tongyi Qianwen Series Models](https://help.aliyun.com/document_detail/2400395.html)

|

||||

+ [x] [Zhipu ChatGLM Series Models](https://bigmodel.cn)

|

||||

- [x] [OpenAI ChatGPT Series Models](https://platform.openai.com/docs/guides/gpt/chat-completions-api) (Supports [Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference))

|

||||

- [x] [Anthropic Claude Series Models](https://anthropic.com)

|

||||

- [x] [Google PaLM2 Series Models](https://developers.generativeai.google)

|

||||

- [x] [Baidu Wenxin Yiyuan Series Models](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

- [x] [Alibaba Tongyi Qianwen Series Models](https://help.aliyun.com/document_detail/2400395.html)

|

||||

- [x] [Zhipu ChatGLM Series Models](https://bigmodel.cn)

|

||||

2. Supports access to multiple channels through **load balancing**.

|

||||

3. Supports **stream mode** that enables typewriter-like effect through stream transmission.

|

||||

4. Supports **multi-machine deployment**. [See here](#multi-machine-deployment) for more details.

|

||||

@ -82,13 +85,15 @@ _✨ Access all LLM through the standard OpenAI API format, easy to deploy & use

|

||||

15. Supports management API access through system access tokens.

|

||||

16. Supports Cloudflare Turnstile user verification.

|

||||

17. Supports user management and multiple user login/registration methods:

|

||||

+ Email login/registration and password reset via email.

|

||||

+ [GitHub OAuth](https://github.com/settings/applications/new).

|

||||

+ WeChat Official Account authorization (requires additional deployment of [WeChat Server](https://github.com/songquanpeng/wechat-server)).

|

||||

- Email login/registration and password reset via email.

|

||||

- [GitHub OAuth](https://github.com/settings/applications/new).

|

||||

- WeChat Official Account authorization (requires additional deployment of [WeChat Server](https://github.com/songquanpeng/wechat-server)).

|

||||

18. Immediate support and encapsulation of other major model APIs as they become available.

|

||||

|

||||

## Deployment

|

||||

|

||||

### Docker Deployment

|

||||

|

||||

Deployment command: `docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api-en`

|

||||

|

||||

Update command: `docker run --rm -v /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower -cR`

|

||||

@ -98,10 +103,11 @@ The first `3000` in `-p 3000:3000` is the port of the host, which can be modifie

|

||||

Data will be saved in the `/home/ubuntu/data/one-api` directory on the host. Ensure that the directory exists and has write permissions, or change it to a suitable directory.

|

||||

|

||||

Nginx reference configuration:

|

||||

|

||||

```

|

||||

server{

|

||||

server_name openai.justsong.cn; # Modify your domain name accordingly

|

||||

|

||||

|

||||

location / {

|

||||

client_max_body_size 64m;

|

||||

proxy_http_version 1.1;

|

||||

@ -115,6 +121,7 @@ server{

|

||||

```

|

||||

|

||||

Next, configure HTTPS with Let's Encrypt certbot:

|

||||

|

||||

```bash

|

||||

# Install certbot on Ubuntu:

|

||||

sudo snap install --classic certbot

|

||||

@ -129,20 +136,23 @@ sudo service nginx restart

|

||||

The initial account username is `root` and password is `123456`.

|

||||

|

||||

### Manual Deployment

|

||||

|

||||

1. Download the executable file from [GitHub Releases](https://github.com/songquanpeng/one-api/releases/latest) or compile from source:

|

||||

|

||||

```shell

|

||||

git clone https://github.com/songquanpeng/one-api.git

|

||||

|

||||

|

||||

# Build the frontend

|

||||

cd one-api/web

|

||||

npm install

|

||||

npm run build

|

||||

|

||||

|

||||

# Build the backend

|

||||

cd ..

|

||||

go mod download

|

||||

go build -ldflags "-s -w" -o one-api

|

||||

```

|

||||

|

||||

2. Run:

|

||||

```shell

|

||||

chmod u+x one-api

|

||||

@ -153,6 +163,7 @@ The initial account username is `root` and password is `123456`.

|

||||

For more detailed deployment tutorials, please refer to [this page](https://iamazing.cn/page/how-to-deploy-a-website).

|

||||

|

||||

### Multi-machine Deployment

|

||||

|

||||

1. Set the same `SESSION_SECRET` for all servers.

|

||||

2. Set `SQL_DSN` and use MySQL instead of SQLite. All servers should connect to the same database.

|

||||

3. Set the `NODE_TYPE` for all non-master nodes to `slave`.

|

||||

@ -164,11 +175,13 @@ For more detailed deployment tutorials, please refer to [this page](https://iama

|

||||

Please refer to the [environment variables](#environment-variables) section for details on using environment variables.

|

||||

|

||||

### Deployment on Control Panels (e.g., Baota)

|

||||

|

||||

Refer to [#175](https://github.com/songquanpeng/one-api/issues/175) for detailed instructions.

|

||||

|

||||

If you encounter a blank page after deployment, refer to [#97](https://github.com/songquanpeng/one-api/issues/97) for possible solutions.

|

||||

|

||||

### Deployment on Third-Party Platforms

|

||||

|

||||

<details>

|

||||

<summary><strong>Deploy on Sealos</strong></summary>

|

||||

<div>

|

||||

@ -179,7 +192,6 @@ If you encounter a blank page after deployment, refer to [#97](https://github.co

|

||||

|

||||

[](https://cloud.sealos.io/?openapp=system-fastdeploy?templateName=one-api)

|

||||

|

||||

|

||||

</div>

|

||||

</details>

|

||||

|

||||

@ -194,7 +206,7 @@ If you encounter a blank page after deployment, refer to [#97](https://github.co

|

||||

1. First, fork the code.

|

||||

2. Go to [Zeabur](https://zeabur.com?referralCode=songquanpeng), log in, and enter the console.

|

||||

3. Create a new project. In Service -> Add Service, select Marketplace, and choose MySQL. Note down the connection parameters (username, password, address, and port).

|

||||

4. Copy the connection parameters and run ```create database `one-api` ``` to create the database.

|

||||

4. Copy the connection parameters and run `` create database `one-api` `` to create the database.

|

||||

5. Then, in Service -> Add Service, select Git (authorization is required for the first use) and choose your forked repository.

|

||||

6. Automatic deployment will start, but please cancel it for now. Go to the Variable tab, add a `PORT` with a value of `3000`, and then add a `SQL_DSN` with a value of `<username>:<password>@tcp(<addr>:<port>)/one-api`. Save the changes. Please note that if `SQL_DSN` is not set, data will not be persisted, and the data will be lost after redeployment.

|

||||

7. Select Redeploy.

|

||||

@ -205,6 +217,7 @@ If you encounter a blank page after deployment, refer to [#97](https://github.co

|

||||

</details>

|

||||

|

||||

## Configuration

|

||||

|

||||

The system is ready to use out of the box.

|

||||

|

||||

You can configure it by setting environment variables or command line parameters.

|

||||

@ -212,6 +225,7 @@ You can configure it by setting environment variables or command line parameters

|

||||

After the system starts, log in as the `root` user to further configure the system.

|

||||

|

||||

## Usage

|

||||

|

||||

Add your API Key on the `Channels` page, and then add an access token on the `Tokens` page.

|

||||

|

||||

You can then use your access token to access One API. The usage is consistent with the [OpenAI API](https://platform.openai.com/docs/api-reference/introduction).

|

||||

@ -235,59 +249,65 @@ Note that the token needs to be created by an administrator to specify the chann

|

||||

If the channel ID is not provided, load balancing will be used to distribute the requests to multiple channels.

|

||||

|

||||

### Environment Variables

|

||||

|

||||

1. `REDIS_CONN_STRING`: When set, Redis will be used as the storage for request rate limiting instead of memory.

|

||||

+ Example: `REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

- Example: `REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

2. `SESSION_SECRET`: When set, a fixed session key will be used to ensure that cookies of logged-in users are still valid after the system restarts.

|

||||

+ Example: `SESSION_SECRET=random_string`

|

||||

- Example: `SESSION_SECRET=random_string`

|

||||

3. `SQL_DSN`: When set, the specified database will be used instead of SQLite. Please use MySQL version 8.0.

|

||||

+ Example: `SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

- Example: `SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

4. `FRONTEND_BASE_URL`: When set, the specified frontend address will be used instead of the backend address.

|

||||

+ Example: `FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

- Example: `FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

5. `SYNC_FREQUENCY`: When set, the system will periodically sync configurations from the database, with the unit in seconds. If not set, no sync will happen.

|

||||

+ Example: `SYNC_FREQUENCY=60`

|

||||

- Example: `SYNC_FREQUENCY=60`

|

||||

6. `NODE_TYPE`: When set, specifies the node type. Valid values are `master` and `slave`. If not set, it defaults to `master`.

|

||||

+ Example: `NODE_TYPE=slave`

|

||||

- Example: `NODE_TYPE=slave`

|

||||

7. `CHANNEL_UPDATE_FREQUENCY`: When set, it periodically updates the channel balances, with the unit in minutes. If not set, no update will happen.

|

||||

+ Example: `CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

- Example: `CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

8. `CHANNEL_TEST_FREQUENCY`: When set, it periodically tests the channels, with the unit in minutes. If not set, no test will happen.

|

||||

+ Example: `CHANNEL_TEST_FREQUENCY=1440`

|

||||

- Example: `CHANNEL_TEST_FREQUENCY=1440`

|

||||

9. `POLLING_INTERVAL`: The time interval (in seconds) between requests when updating channel balances and testing channel availability. Default is no interval.

|

||||

+ Example: `POLLING_INTERVAL=5`

|

||||

- Example: `POLLING_INTERVAL=5`

|

||||

|

||||

### Command Line Parameters

|

||||

|

||||

1. `--port <port_number>`: Specifies the port number on which the server listens. Defaults to `3000`.

|

||||

+ Example: `--port 3000`

|

||||

- Example: `--port 3000`

|

||||

2. `--log-dir <log_dir>`: Specifies the log directory. If not set, the logs will not be saved.

|

||||

+ Example: `--log-dir ./logs`

|

||||

- Example: `--log-dir ./logs`

|

||||

3. `--version`: Prints the system version number and exits.

|

||||

4. `--help`: Displays the command usage help and parameter descriptions.

|

||||

|

||||

## Screenshots

|

||||

|

||||

|

||||

|

||||

|

||||

## FAQ

|

||||

|

||||

1. What is quota? How is it calculated? Does One API have quota calculation issues?

|

||||

+ Quota = Group multiplier * Model multiplier * (number of prompt tokens + number of completion tokens * completion multiplier)

|

||||

+ The completion multiplier is fixed at 1.33 for GPT3.5 and 2 for GPT4, consistent with the official definition.

|

||||

+ If it is not a stream mode, the official API will return the total number of tokens consumed. However, please note that the consumption multipliers for prompts and completions are different.

|

||||

- Quota = Group multiplier _ Model multiplier _ (number of prompt tokens + number of completion tokens \* completion multiplier)

|

||||

- The completion multiplier is fixed at 1.33 for GPT3.5 and 2 for GPT4, consistent with the official definition.

|

||||

- If it is not a stream mode, the official API will return the total number of tokens consumed. However, please note that the consumption multipliers for prompts and completions are different.

|

||||

2. Why does it prompt "insufficient quota" even though my account balance is sufficient?

|

||||

+ Please check if your token quota is sufficient. It is separate from the account balance.

|

||||

+ The token quota is used to set the maximum usage and can be freely set by the user.

|

||||

- Please check if your token quota is sufficient. It is separate from the account balance.

|

||||

- The token quota is used to set the maximum usage and can be freely set by the user.

|

||||

3. It says "No available channels" when trying to use a channel. What should I do?

|

||||

+ Please check the user and channel group settings.

|

||||

+ Also check the channel model settings.

|

||||

- Please check the user and channel group settings.

|

||||

- Also check the channel model settings.

|

||||

4. Channel testing reports an error: "invalid character '<' looking for beginning of value"

|

||||

+ This error occurs when the returned value is not valid JSON but an HTML page.

|

||||

+ Most likely, the IP of your deployment site or the node of the proxy has been blocked by CloudFlare.

|

||||

- This error occurs when the returned value is not valid JSON but an HTML page.

|

||||

- Most likely, the IP of your deployment site or the node of the proxy has been blocked by CloudFlare.

|

||||

5. ChatGPT Next Web reports an error: "Failed to fetch"

|

||||

+ Do not set `BASE_URL` during deployment.

|

||||

+ Double-check that your interface address and API Key are correct.

|

||||

- Do not set `BASE_URL` during deployment.

|

||||

- Double-check that your interface address and API Key are correct.

|

||||

|

||||

## Related Projects

|

||||

|

||||

[FastGPT](https://github.com/labring/FastGPT): Knowledge question answering system based on the LLM

|

||||

|

||||

## Note

|

||||

|

||||

This project is an open-source project. Please use it in compliance with OpenAI's [Terms of Use](https://openai.com/policies/terms-of-use) and **applicable laws and regulations**. It must not be used for illegal purposes.

|

||||

|

||||

This project is released under the MIT license. Based on this, attribution and a link to this project must be included at the bottom of the page.

|

||||

|

||||

126

README.ja.md

126

README.ja.md

@ -10,28 +10,30 @@

|

||||

|

||||

# One API

|

||||

|

||||

_このプロジェクトは、[one-api](https://github.com/songquanpeng/one-api)をベースにしており、元のプロジェクトのモジュールコードを分離し、モジュール化し、フロントエンドのインターフェースを変更しました。このプロジェクトも MIT ライセンスに従っています。_

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/MartialBE/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/MartialBE/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/MartialBE/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/MartialBE/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

## スクリーンショット

|

||||

|

||||

|

||||

|

||||

|

||||

_以下は元の項目の説明です:_

|

||||

|

||||

---

|

||||

|

||||

_✨ 標準的な OpenAI API フォーマットを通じてすべての LLM にアクセスでき、導入と利用が容易です ✨_

|

||||

|

||||

</div>

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/songquanpeng/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/songquanpeng/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/v/release/songquanpeng/one-api?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://hub.docker.com/repository/docker/justsong/one-api">

|

||||

<img src="https://img.shields.io/docker/pulls/justsong/one-api?color=brightgreen" alt="docker pull">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/downloads/songquanpeng/one-api/total?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/songquanpeng/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/songquanpeng/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

<p align="center">

|

||||

<a href="#deployment">デプロイチュートリアル</a>

|

||||

·

|

||||

@ -57,13 +59,14 @@ _✨ 標準的な OpenAI API フォーマットを通じてすべての LLM に

|

||||

> **注**: Docker からプルされた最新のイメージは、`alpha` リリースかもしれません。安定性が必要な場合は、手動でバージョンを指定してください。

|

||||

|

||||

## 特徴

|

||||

|

||||

1. 複数の大型モデルをサポート:

|

||||

+ [x] [OpenAI ChatGPT シリーズモデル](https://platform.openai.com/docs/guides/gpt/chat-completions-api) ([Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference) をサポート)

|

||||

+ [x] [Anthropic Claude シリーズモデル](https://anthropic.com)

|

||||

+ [x] [Google PaLM2 シリーズモデル](https://developers.generativeai.google)

|

||||

+ [x] [Baidu Wenxin Yiyuan シリーズモデル](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

+ [x] [Alibaba Tongyi Qianwen シリーズモデル](https://help.aliyun.com/document_detail/2400395.html)

|

||||

+ [x] [Zhipu ChatGLM シリーズモデル](https://bigmodel.cn)

|

||||

- [x] [OpenAI ChatGPT シリーズモデル](https://platform.openai.com/docs/guides/gpt/chat-completions-api) ([Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference) をサポート)

|

||||

- [x] [Anthropic Claude シリーズモデル](https://anthropic.com)

|

||||

- [x] [Google PaLM2 シリーズモデル](https://developers.generativeai.google)

|

||||

- [x] [Baidu Wenxin Yiyuan シリーズモデル](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

- [x] [Alibaba Tongyi Qianwen シリーズモデル](https://help.aliyun.com/document_detail/2400395.html)

|

||||

- [x] [Zhipu ChatGLM シリーズモデル](https://bigmodel.cn)

|

||||

2. **ロードバランシング**による複数チャンネルへのアクセスをサポート。

|

||||

3. ストリーム伝送によるタイプライター的効果を可能にする**ストリームモード**に対応。

|

||||

4. **マルチマシンデプロイ**に対応。[詳細はこちら](#multi-machine-deployment)を参照。

|

||||

@ -82,13 +85,15 @@ _✨ 標準的な OpenAI API フォーマットを通じてすべての LLM に

|

||||

15. システム・アクセストークンによる管理 API アクセスをサポートする。

|

||||

16. Cloudflare Turnstile によるユーザー認証に対応。

|

||||

17. ユーザー管理と複数のユーザーログイン/登録方法をサポート:

|

||||

+ 電子メールによるログイン/登録とパスワードリセット。

|

||||

+ [GitHub OAuth](https://github.com/settings/applications/new)。

|

||||

+ WeChat 公式アカウントの認証([WeChat Server](https://github.com/songquanpeng/wechat-server)の追加導入が必要)。

|

||||

- 電子メールによるログイン/登録とパスワードリセット。

|

||||

- [GitHub OAuth](https://github.com/settings/applications/new)。

|

||||

- WeChat 公式アカウントの認証([WeChat Server](https://github.com/songquanpeng/wechat-server)の追加導入が必要)。

|

||||

18. 他の主要なモデル API が利用可能になった場合、即座にサポートし、カプセル化する。

|

||||

|

||||

## デプロイメント

|

||||

|

||||

### Docker デプロイメント

|

||||

|

||||

デプロイコマンド: `docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api-en`。

|

||||

|

||||

コマンドを更新する: `docker run --rm -v /var/run/docker.sock:/var/run/docker.sock containrr/watchtower -cR`。

|

||||

@ -97,7 +102,8 @@ _✨ 標準的な OpenAI API フォーマットを通じてすべての LLM に

|

||||

|

||||

データはホストの `/home/ubuntu/data/one-api` ディレクトリに保存される。このディレクトリが存在し、書き込み権限があることを確認する、もしくは適切なディレクトリに変更してください。

|

||||

|

||||

Nginxリファレンス設定:

|

||||

Nginx リファレンス設定:

|

||||

|

||||

```

|

||||

server{

|

||||

server_name openai.justsong.cn; # ドメイン名は適宜変更

|

||||

@ -116,6 +122,7 @@ server{

|

||||

```

|

||||

|

||||

次に、Let's Encrypt certbot を使って HTTPS を設定します:

|

||||

|

||||

```bash

|

||||

# Ubuntu に certbot をインストール:

|

||||

sudo snap install --classic certbot

|

||||

@ -130,7 +137,9 @@ sudo service nginx restart

|

||||

初期アカウントのユーザー名は `root` で、パスワードは `123456` です。

|

||||

|

||||

### マニュアルデプロイ

|

||||

|

||||

1. [GitHub Releases](https://github.com/songquanpeng/one-api/releases/latest) から実行ファイルをダウンロードする、もしくはソースからコンパイルする:

|

||||

|

||||

```shell

|

||||

git clone https://github.com/songquanpeng/one-api.git

|

||||

|

||||

@ -144,6 +153,7 @@ sudo service nginx restart

|

||||

go mod download

|

||||

go build -ldflags "-s -w" -o one-api

|

||||

```

|

||||

|

||||

2. 実行:

|

||||

```shell

|

||||

chmod u+x one-api

|

||||

@ -154,6 +164,7 @@ sudo service nginx restart

|

||||

より詳細なデプロイのチュートリアルについては、[このページ](https://iamazing.cn/page/how-to-deploy-a-website) を参照してください。

|

||||

|

||||

### マルチマシンデプロイ

|

||||

|

||||

1. すべてのサーバに同じ `SESSION_SECRET` を設定する。

|

||||

2. `SQL_DSN` を設定し、SQLite の代わりに MySQL を使用する。すべてのサーバは同じデータベースに接続する。

|

||||

3. マスターノード以外のノードの `NODE_TYPE` を `slave` に設定する。

|

||||

@ -165,11 +176,13 @@ sudo service nginx restart

|

||||

Please refer to the [environment variables](#environment-variables) section for details on using environment variables.

|

||||

|

||||

### コントロールパネル(例: Baota)への展開

|

||||

|

||||

詳しい手順は [#175](https://github.com/songquanpeng/one-api/issues/175) を参照してください。

|

||||

|

||||

配置後に空白のページが表示される場合は、[#97](https://github.com/songquanpeng/one-api/issues/97) を参照してください。

|

||||

|

||||

### サードパーティプラットフォームへのデプロイ

|

||||

|

||||

<details>

|

||||

<summary><strong>Sealos へのデプロイ</strong></summary>

|

||||

<div>

|

||||

@ -180,7 +193,6 @@ Please refer to the [environment variables](#environment-variables) section for

|

||||

|

||||

[](https://cloud.sealos.io/?openapp=system-fastdeploy?templateName=one-api)

|

||||

|

||||

|

||||

</div>

|

||||

</details>

|

||||

|

||||

@ -194,8 +206,8 @@ Please refer to the [environment variables](#environment-variables) section for

|

||||

|

||||

1. まず、コードをフォークする。

|

||||

2. [Zeabur](https://zeabur.com?referralCode=songquanpeng) にアクセスしてログインし、コンソールに入る。

|

||||

3. 新しいプロジェクトを作成します。Service -> Add ServiceでMarketplace を選択し、MySQL を選択する。接続パラメータ(ユーザー名、パスワード、アドレス、ポート)をメモします。

|

||||

4. 接続パラメータをコピーし、```create database `one-api` ``` を実行してデータベースを作成する。

|

||||

3. 新しいプロジェクトを作成します。Service -> Add Service で Marketplace を選択し、MySQL を選択する。接続パラメータ(ユーザー名、パスワード、アドレス、ポート)をメモします。

|

||||

4. 接続パラメータをコピーし、`` create database `one-api` `` を実行してデータベースを作成する。

|

||||

5. その後、Service -> Add Service で Git を選択し(最初の使用には認証が必要です)、フォークしたリポジトリを選択します。

|

||||

6. 自動デプロイが開始されますが、一旦キャンセルしてください。Variable タブで `PORT` に `3000` を追加し、`SQL_DSN` に `<username>:<password>@tcp(<addr>:<port>)/one-api` を追加します。変更を保存する。SQL_DSN` が設定されていないと、データが永続化されず、再デプロイ後にデータが失われるので注意すること。

|

||||

7. 再デプロイを選択します。

|

||||

@ -206,6 +218,7 @@ Please refer to the [environment variables](#environment-variables) section for

|

||||

</details>

|

||||

|

||||

## コンフィグ

|

||||

|

||||

システムは箱から出してすぐに使えます。

|

||||

|

||||

環境変数やコマンドラインパラメータを設定することで、システムを構成することができます。

|

||||

@ -213,6 +226,7 @@ Please refer to the [environment variables](#environment-variables) section for

|

||||

システム起動後、`root` ユーザーとしてログインし、さらにシステムを設定します。

|

||||

|

||||

## 使用方法

|

||||

|

||||

`Channels` ページで API Key を追加し、`Tokens` ページでアクセストークンを追加する。

|

||||

|

||||

アクセストークンを使って One API にアクセスすることができる。使い方は [OpenAI API](https://platform.openai.com/docs/api-reference/introduction) と同じです。

|

||||

@ -236,59 +250,65 @@ graph LR

|

||||

もしチャネル ID が指定されない場合、ロードバランシングによってリクエストが複数のチャネルに振り分けられます。

|

||||

|

||||

### 環境変数

|

||||

|

||||

1. `REDIS_CONN_STRING`: 設定すると、リクエストレート制限のためのストレージとして、メモリの代わりに Redis が使われる。

|

||||

+ 例: `REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

- 例: `REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

2. `SESSION_SECRET`: 設定すると、固定セッションキーが使用され、システムの再起動後もログインユーザーのクッキーが有効であることが保証されます。

|

||||

+ 例: `SESSION_SECRET=random_string`

|

||||

- 例: `SESSION_SECRET=random_string`

|

||||

3. `SQL_DSN`: 設定すると、SQLite の代わりに指定したデータベースが使用されます。MySQL バージョン 8.0 を使用してください。

|

||||

+ 例: `SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

- 例: `SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

4. `FRONTEND_BASE_URL`: 設定されると、バックエンドアドレスではなく、指定されたフロントエンドアドレスが使われる。

|

||||

+ 例: `FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

- 例: `FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

5. `SYNC_FREQUENCY`: 設定された場合、システムは定期的にデータベースからコンフィグを秒単位で同期する。設定されていない場合、同期は行われません。

|

||||

+ 例: `SYNC_FREQUENCY=60`

|

||||

- 例: `SYNC_FREQUENCY=60`

|

||||

6. `NODE_TYPE`: 設定すると、ノードのタイプを指定する。有効な値は `master` と `slave` である。設定されていない場合、デフォルトは `master`。

|

||||

+ 例: `NODE_TYPE=slave`

|

||||

- 例: `NODE_TYPE=slave`

|

||||

7. `CHANNEL_UPDATE_FREQUENCY`: 設定すると、チャンネル残高を分単位で定期的に更新する。設定されていない場合、更新は行われません。

|

||||

+ 例: `CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

- 例: `CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

8. `CHANNEL_TEST_FREQUENCY`: 設定すると、チャンネルを定期的にテストする。設定されていない場合、テストは行われません。

|

||||

+ 例: `CHANNEL_TEST_FREQUENCY=1440`

|

||||

- 例: `CHANNEL_TEST_FREQUENCY=1440`

|

||||

9. `POLLING_INTERVAL`: チャネル残高の更新とチャネルの可用性をテストするときのリクエスト間の時間間隔 (秒)。デフォルトは間隔なし。

|

||||

+ 例: `POLLING_INTERVAL=5`

|

||||

- 例: `POLLING_INTERVAL=5`

|

||||

|

||||

### コマンドラインパラメータ

|

||||

|

||||

1. `--port <port_number>`: サーバがリッスンするポート番号を指定。デフォルトは `3000` です。

|

||||

+ 例: `--port 3000`

|

||||

- 例: `--port 3000`

|

||||

2. `--log-dir <log_dir>`: ログディレクトリを指定。設定しない場合、ログは保存されません。

|

||||

+ 例: `--log-dir ./logs`

|

||||

- 例: `--log-dir ./logs`

|

||||

3. `--version`: システムのバージョン番号を表示して終了する。

|

||||

4. `--help`: コマンドの使用法ヘルプとパラメータの説明を表示。

|

||||

|

||||

## スクリーンショット

|

||||

|

||||

|

||||

|

||||

|

||||

## FAQ

|

||||

|

||||

1. ノルマとは何か?どのように計算されますか?One API にはノルマ計算の問題はありますか?

|

||||

+ ノルマ = グループ倍率 * モデル倍率 * (プロンプトトークンの数 + 完了トークンの数 * 完了倍率)

|

||||

+ 完了倍率は、公式の定義と一致するように、GPT3.5 では 1.33、GPT4 では 2 に固定されています。

|

||||

+ ストリームモードでない場合、公式 API は消費したトークンの総数を返す。ただし、プロンプトとコンプリートの消費倍率は異なるので注意してください。

|

||||

- ノルマ = グループ倍率 _ モデル倍率 _ (プロンプトトークンの数 + 完了トークンの数 \* 完了倍率)

|

||||

- 完了倍率は、公式の定義と一致するように、GPT3.5 では 1.33、GPT4 では 2 に固定されています。

|

||||

- ストリームモードでない場合、公式 API は消費したトークンの総数を返す。ただし、プロンプトとコンプリートの消費倍率は異なるので注意してください。

|

||||

2. アカウント残高は十分なのに、"insufficient quota" と表示されるのはなぜですか?

|

||||

+ トークンのクォータが十分かどうかご確認ください。トークンクォータはアカウント残高とは別のものです。

|

||||

+ トークンクォータは最大使用量を設定するためのもので、ユーザーが自由に設定できます。

|

||||

- トークンのクォータが十分かどうかご確認ください。トークンクォータはアカウント残高とは別のものです。

|

||||

- トークンクォータは最大使用量を設定するためのもので、ユーザーが自由に設定できます。

|

||||

3. チャンネルを使おうとすると "No available channels" と表示されます。どうすればいいですか?

|

||||

+ ユーザーとチャンネルグループの設定を確認してください。

|

||||

+ チャンネルモデルの設定も確認してください。

|

||||

- ユーザーとチャンネルグループの設定を確認してください。

|

||||

- チャンネルモデルの設定も確認してください。

|

||||

4. チャンネルテストがエラーを報告する: "invalid character '<' looking for beginning of value"

|

||||

+ このエラーは、返された値が有効な JSON ではなく、HTML ページである場合に発生する。

|

||||

+ ほとんどの場合、デプロイサイトのIPかプロキシのノードが CloudFlare によってブロックされています。

|

||||

- このエラーは、返された値が有効な JSON ではなく、HTML ページである場合に発生する。

|

||||

- ほとんどの場合、デプロイサイトの IP かプロキシのノードが CloudFlare によってブロックされています。

|

||||

5. ChatGPT Next Web でエラーが発生しました: "Failed to fetch"

|

||||

+ デプロイ時に `BASE_URL` を設定しないでください。

|

||||

+ インターフェイスアドレスと API Key が正しいか再確認してください。

|

||||

- デプロイ時に `BASE_URL` を設定しないでください。

|

||||

- インターフェイスアドレスと API Key が正しいか再確認してください。

|

||||

|

||||

## 関連プロジェクト

|

||||

|

||||

[FastGPT](https://github.com/labring/FastGPT): LLM に基づく知識質問応答システム

|

||||

|

||||

## 注

|

||||

|

||||

本プロジェクトはオープンソースプロジェクトです。OpenAI の[利用規約](https://openai.com/policies/terms-of-use)および**適用される法令**を遵守してご利用ください。違法な目的での利用はご遠慮ください。

|

||||

|

||||

このプロジェクトは MIT ライセンスで公開されています。これに基づき、ページの最下部に帰属表示と本プロジェクトへのリンクを含める必要があります。

|

||||

|

||||

220

README.md

220

README.md

@ -2,37 +2,38 @@

|

||||

<strong>中文</strong> | <a href="./README.en.md">English</a> | <a href="./README.ja.md">日本語</a>

|

||||

</p>

|

||||

|

||||

|

||||

<p align="center">

|

||||

<a href="https://github.com/songquanpeng/one-api"><img src="https://raw.githubusercontent.com/songquanpeng/one-api/main/web/public/logo.png" width="150" height="150" alt="one-api logo"></a>

|

||||

<a href="https://github.com/MartialBE/one-api"><img src="https://raw.githubusercontent.com/MartialBE/one-api/main/web/src/assets/images/logo.svg" width="150" height="150" alt="one-api logo"></a>

|

||||

</p>

|

||||

|

||||

<div align="center">

|

||||

|

||||

# One API

|

||||

|

||||

_本项目是基于[one-api](https://github.com/songquanpeng/one-api)二次开发而来的,主要将原项目中的模块代码分离,模块化,并修改了前端界面。本项目同样遵循 MIT 协议。_

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/MartialBE/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/MartialBE/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/MartialBE/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/MartialBE/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

# 截图展示

|

||||

|

||||

|

||||

|

||||

|

||||

_以下为原项目说明:_

|

||||

|

||||

---

|

||||

|

||||

_✨ 通过标准的 OpenAI API 格式访问所有的大模型,开箱即用 ✨_

|

||||

|

||||

</div>

|

||||

|

||||

<p align="center">

|

||||

<a href="https://raw.githubusercontent.com/songquanpeng/one-api/main/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/songquanpeng/one-api?color=brightgreen" alt="license">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/v/release/songquanpeng/one-api?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://hub.docker.com/repository/docker/justsong/one-api">

|

||||

<img src="https://img.shields.io/docker/pulls/justsong/one-api?color=brightgreen" alt="docker pull">

|

||||

</a>

|

||||

<a href="https://github.com/songquanpeng/one-api/releases/latest">

|

||||

<img src="https://img.shields.io/github/downloads/songquanpeng/one-api/total?color=brightgreen&include_prereleases" alt="release">

|

||||

</a>

|

||||

<a href="https://goreportcard.com/report/github.com/songquanpeng/one-api">

|

||||

<img src="https://goreportcard.com/badge/github.com/songquanpeng/one-api" alt="GoReportCard">

|

||||

</a>

|

||||

</p>

|

||||

|

||||

<p align="center">

|

||||

<a href="https://github.com/songquanpeng/one-api#部署">部署教程</a>

|

||||

·

|

||||

@ -53,7 +54,7 @@ _✨ 通过标准的 OpenAI API 格式访问所有的大模型,开箱即用

|

||||

|

||||

> **Note**

|

||||

> 本项目为开源项目,使用者必须在遵循 OpenAI 的[使用条款](https://openai.com/policies/terms-of-use)以及**法律法规**的情况下使用,不得用于非法用途。

|

||||

>

|

||||

>

|

||||

> 根据[《生成式人工智能服务管理暂行办法》](http://www.cac.gov.cn/2023-07/13/c_1690898327029107.htm)的要求,请勿对中国地区公众提供一切未经备案的生成式人工智能服务。

|

||||

|

||||

> **Warning**

|

||||

@ -63,23 +64,24 @@ _✨ 通过标准的 OpenAI API 格式访问所有的大模型,开箱即用

|

||||

> 使用 root 用户初次登录系统后,务必修改默认密码 `123456`!

|

||||

|

||||

## 功能

|

||||

|

||||

1. 支持多种大模型:

|

||||

+ [x] [OpenAI ChatGPT 系列模型](https://platform.openai.com/docs/guides/gpt/chat-completions-api)(支持 [Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference))

|

||||

+ [x] [Anthropic Claude 系列模型](https://anthropic.com)

|

||||

+ [x] [Google PaLM2 系列模型](https://developers.generativeai.google)

|

||||

+ [x] [百度文心一言系列模型](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

+ [x] [阿里通义千问系列模型](https://help.aliyun.com/document_detail/2400395.html)

|

||||

+ [x] [讯飞星火认知大模型](https://www.xfyun.cn/doc/spark/Web.html)

|

||||

+ [x] [智谱 ChatGLM 系列模型](https://bigmodel.cn)

|

||||

+ [x] [360 智脑](https://ai.360.cn)

|

||||

+ [x] [腾讯混元大模型](https://cloud.tencent.com/document/product/1729)

|

||||

- [x] [OpenAI ChatGPT 系列模型](https://platform.openai.com/docs/guides/gpt/chat-completions-api)(支持 [Azure OpenAI API](https://learn.microsoft.com/en-us/azure/ai-services/openai/reference))

|

||||

- [x] [Anthropic Claude 系列模型](https://anthropic.com)

|

||||

- [x] [Google PaLM2 系列模型](https://developers.generativeai.google)

|

||||

- [x] [百度文心一言系列模型](https://cloud.baidu.com/doc/WENXINWORKSHOP/index.html)

|

||||

- [x] [阿里通义千问系列模型](https://help.aliyun.com/document_detail/2400395.html)

|

||||

- [x] [讯飞星火认知大模型](https://www.xfyun.cn/doc/spark/Web.html)

|

||||

- [x] [智谱 ChatGLM 系列模型](https://bigmodel.cn)

|

||||

- [x] [360 智脑](https://ai.360.cn)

|

||||

- [x] [腾讯混元大模型](https://cloud.tencent.com/document/product/1729)

|

||||

2. 支持配置镜像以及众多第三方代理服务:

|

||||

+ [x] [OpenAI-SB](https://openai-sb.com)

|

||||

+ [x] [CloseAI](https://referer.shadowai.xyz/r/2412)

|

||||

+ [x] [API2D](https://api2d.com/r/197971)

|

||||

+ [x] [OhMyGPT](https://aigptx.top?aff=uFpUl2Kf)

|

||||

+ [x] [AI Proxy](https://aiproxy.io/?i=OneAPI) (邀请码:`OneAPI`)

|

||||

+ [x] 自定义渠道:例如各种未收录的第三方代理服务

|

||||

- [x] [OpenAI-SB](https://openai-sb.com)

|

||||

- [x] [CloseAI](https://referer.shadowai.xyz/r/2412)

|

||||

- [x] [API2D](https://api2d.com/r/197971)

|

||||

- [x] [OhMyGPT](https://aigptx.top?aff=uFpUl2Kf)

|

||||

- [x] [AI Proxy](https://aiproxy.io/?i=OneAPI) (邀请码:`OneAPI`)

|

||||

- [x] 自定义渠道:例如各种未收录的第三方代理服务

|

||||

3. 支持通过**负载均衡**的方式访问多个渠道。

|

||||

4. 支持 **stream 模式**,可以通过流式传输实现打字机效果。

|

||||

5. 支持**多机部署**,[详见此处](#多机部署)。

|

||||

@ -102,12 +104,14 @@ _✨ 通过标准的 OpenAI API 格式访问所有的大模型,开箱即用

|

||||

20. 支持通过系统访问令牌访问管理 API(bearer token,用以替代 cookie,你可以自行抓包来查看 API 的用法)。

|

||||

21. 支持 Cloudflare Turnstile 用户校验。

|

||||

22. 支持用户管理,支持**多种用户登录注册方式**:

|

||||

+ 邮箱登录注册(支持注册邮箱白名单)以及通过邮箱进行密码重置。

|

||||

+ [GitHub 开放授权](https://github.com/settings/applications/new)。

|

||||

+ 微信公众号授权(需要额外部署 [WeChat Server](https://github.com/songquanpeng/wechat-server))。

|

||||

- 邮箱登录注册(支持注册邮箱白名单)以及通过邮箱进行密码重置。

|

||||

- [GitHub 开放授权](https://github.com/settings/applications/new)。

|

||||

- 微信公众号授权(需要额外部署 [WeChat Server](https://github.com/songquanpeng/wechat-server))。

|

||||

|

||||

## 部署

|

||||

|

||||

### 基于 Docker 进行部署

|

||||

|

||||

```shell

|

||||

# 使用 SQLite 的部署命令:

|

||||

docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api

|

||||

@ -129,10 +133,11 @@ docker run --name one-api -d --restart always -p 3000:3000 -e SQL_DSN="root:1234

|

||||

更新命令:`docker run --rm -v /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower -cR`

|

||||

|

||||

Nginx 的参考配置:

|

||||

|

||||

```

|

||||

server{

|

||||

server_name openai.justsong.cn; # 请根据实际情况修改你的域名

|

||||

|

||||

|

||||

location / {

|

||||

client_max_body_size 64m;

|

||||

proxy_http_version 1.1;

|

||||

@ -147,6 +152,7 @@ server{

|

||||

```

|

||||

|

||||

之后使用 Let's Encrypt 的 certbot 配置 HTTPS:

|

||||

|

||||

```bash

|

||||

# Ubuntu 安装 certbot:

|

||||

sudo snap install --classic certbot

|

||||

@ -160,7 +166,6 @@ sudo service nginx restart

|

||||

|

||||

初始账号用户名为 `root`,密码为 `123456`。

|

||||

|

||||

|

||||

### 基于 Docker Compose 进行部署

|

||||

|

||||

> 仅启动方式不同,参数设置不变,请参考基于 Docker 部署部分

|

||||

@ -174,20 +179,23 @@ docker-compose ps

|

||||

```

|

||||

|

||||

### 手动部署

|

||||

|

||||

1. 从 [GitHub Releases](https://github.com/songquanpeng/one-api/releases/latest) 下载可执行文件或者从源码编译:

|

||||

|

||||

```shell

|

||||

git clone https://github.com/songquanpeng/one-api.git

|

||||

|

||||

|

||||

# 构建前端

|

||||

cd one-api/web

|

||||

npm install

|

||||

npm run build

|

||||

|

||||

|

||||

# 构建后端

|

||||

cd ..

|

||||

go mod download

|

||||

go build -ldflags "-s -w" -o one-api

|

||||

````

|

||||

```

|

||||

|

||||

2. 运行:

|

||||

```shell

|

||||

chmod u+x one-api

|

||||

@ -198,6 +206,7 @@ docker-compose ps

|

||||

更加详细的部署教程[参见此处](https://iamazing.cn/page/how-to-deploy-a-website)。

|

||||

|

||||

### 多机部署

|

||||

|

||||

1. 所有服务器 `SESSION_SECRET` 设置一样的值。

|

||||

2. 必须设置 `SQL_DSN`,使用 MySQL 数据库而非 SQLite,所有服务器连接同一个数据库。

|

||||

3. 所有从服务器必须设置 `NODE_TYPE` 为 `slave`,不设置则默认为主服务器。

|

||||

@ -215,9 +224,11 @@ docker-compose ps

|

||||

如果部署后访问出现空白页面,详见 [#97](https://github.com/songquanpeng/one-api/issues/97)。

|

||||

|

||||

### 部署第三方服务配合 One API 使用

|

||||

|

||||

> 欢迎 PR 添加更多示例。

|

||||

|

||||

#### ChatGPT Next Web

|

||||

|

||||

项目主页:https://github.com/Yidadaa/ChatGPT-Next-Web

|

||||

|

||||

```bash

|

||||

@ -227,6 +238,7 @@ docker run --name chat-next-web -d -p 3001:3000 yidadaa/chatgpt-next-web

|

||||

注意修改端口号,之后在页面上设置接口地址(例如:https://openai.justsong.cn/ )和 API Key 即可。

|

||||

|

||||

#### ChatGPT Web

|

||||

|

||||

项目主页:https://github.com/Chanzhaoyu/chatgpt-web

|

||||

|

||||

```bash

|

||||

@ -235,14 +247,16 @@ docker run --name chatgpt-web -d -p 3002:3002 -e OPENAI_API_BASE_URL=https://ope

|

||||

|

||||

注意修改端口号、`OPENAI_API_BASE_URL` 和 `OPENAI_API_KEY`。

|

||||

|

||||

#### QChatGPT - QQ机器人

|

||||

#### QChatGPT - QQ 机器人

|

||||

|

||||

项目主页:https://github.com/RockChinQ/QChatGPT

|

||||

|

||||

根据文档完成部署后,在`config.py`设置配置项`openai_config`的`reverse_proxy`为 One API 后端地址,设置`api_key`为 One API 生成的key,并在配置项`completion_api_params`的`model`参数设置为 One API 支持的模型名称。

|

||||

根据文档完成部署后,在`config.py`设置配置项`openai_config`的`reverse_proxy`为 One API 后端地址,设置`api_key`为 One API 生成的 key,并在配置项`completion_api_params`的`model`参数设置为 One API 支持的模型名称。

|

||||

|

||||

可安装 [Switcher 插件](https://github.com/RockChinQ/Switcher)在运行时切换所使用的模型。

|

||||

|

||||

### 部署到第三方平台

|

||||

|

||||

<details>

|

||||

<summary><strong>部署到 Sealos </strong></summary>

|

||||

<div>

|

||||

@ -267,7 +281,7 @@ docker run --name chatgpt-web -d -p 3002:3002 -e OPENAI_API_BASE_URL=https://ope

|

||||

1. 首先 fork 一份代码。

|

||||

2. 进入 [Zeabur](https://zeabur.com?referralCode=songquanpeng),登录,进入控制台。

|

||||

3. 新建一个 Project,在 Service -> Add Service 选择 Marketplace,选择 MySQL,并记下连接参数(用户名、密码、地址、端口)。

|

||||

4. 复制链接参数,运行 ```create database `one-api` ``` 创建数据库。

|

||||

4. 复制链接参数,运行 `` create database `one-api` `` 创建数据库。

|

||||

5. 然后在 Service -> Add Service,选择 Git(第一次使用需要先授权),选择你 fork 的仓库。

|

||||

6. Deploy 会自动开始,先取消。进入下方 Variable,添加一个 `PORT`,值为 `3000`,再添加一个 `SQL_DSN`,值为 `<username>:<password>@tcp(<addr>:<port>)/one-api` ,然后保存。 注意如果不填写 `SQL_DSN`,数据将无法持久化,重新部署后数据会丢失。

|

||||

7. 选择 Redeploy。

|

||||

@ -289,6 +303,7 @@ Render 可以直接部署 docker 镜像,不需要 fork 仓库:https://dashbo

|

||||

</details>

|

||||

|

||||

## 配置

|

||||

|

||||

系统本身开箱即用。

|

||||

|

||||

你可以通过设置环境变量或者命令行参数进行配置。

|

||||

@ -298,6 +313,7 @@ Render 可以直接部署 docker 镜像,不需要 fork 仓库:https://dashbo

|

||||

**Note**:如果你不知道某个配置项的含义,可以临时删掉值以看到进一步的提示文字。

|

||||

|

||||

## 使用方法

|

||||

|

||||

在`渠道`页面中添加你的 API Key,之后在`令牌`页面中新增访问令牌。

|

||||

|

||||

之后就可以使用你的令牌访问 One API 了,使用方式与 [OpenAI API](https://platform.openai.com/docs/api-reference/introduction) 一致。

|

||||

@ -307,9 +323,10 @@ Render 可以直接部署 docker 镜像,不需要 fork 仓库:https://dashbo

|

||||

注意,具体的 API Base 的格式取决于你所使用的客户端。

|

||||

|

||||

例如对于 OpenAI 的官方库:

|

||||

|

||||

```bash

|

||||

OPENAI_API_KEY="sk-xxxxxx"

|

||||

OPENAI_API_BASE="https://<HOST>:<PORT>/v1"

|

||||

OPENAI_API_BASE="https://<HOST>:<PORT>/v1"

|

||||

```

|

||||

|

||||

```mermaid

|

||||

@ -328,98 +345,105 @@ graph LR

|

||||

不加的话将会使用负载均衡的方式使用多个渠道。

|

||||

|

||||

### 环境变量

|

||||

|

||||

1. `REDIS_CONN_STRING`:设置之后将使用 Redis 作为缓存使用。

|

||||

+ 例子:`REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

+ 如果数据库访问延迟很低,没有必要启用 Redis,启用后反而会出现数据滞后的问题。

|

||||

- 例子:`REDIS_CONN_STRING=redis://default:redispw@localhost:49153`

|

||||

- 如果数据库访问延迟很低,没有必要启用 Redis,启用后反而会出现数据滞后的问题。

|

||||

2. `SESSION_SECRET`:设置之后将使用固定的会话密钥,这样系统重新启动后已登录用户的 cookie 将依旧有效。

|

||||

+ 例子:`SESSION_SECRET=random_string`

|

||||

- 例子:`SESSION_SECRET=random_string`

|

||||

3. `SQL_DSN`:设置之后将使用指定数据库而非 SQLite,请使用 MySQL 或 PostgreSQL。

|

||||

+ 例子:

|

||||

+ MySQL:`SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

+ PostgreSQL:`SQL_DSN=postgres://postgres:123456@localhost:5432/oneapi`(适配中,欢迎反馈)

|

||||

+ 注意需要提前建立数据库 `oneapi`,无需手动建表,程序将自动建表。

|

||||

+ 如果使用本地数据库:部署命令可添加 `--network="host"` 以使得容器内的程序可以访问到宿主机上的 MySQL。

|

||||

+ 如果使用云数据库:如果云服务器需要验证身份,需要在连接参数中添加 `?tls=skip-verify`。

|

||||

+ 请根据你的数据库配置修改下列参数(或者保持默认值):

|

||||

+ `SQL_MAX_IDLE_CONNS`:最大空闲连接数,默认为 `100`。

|

||||

+ `SQL_MAX_OPEN_CONNS`:最大打开连接数,默认为 `1000`。

|

||||

+ 如果报错 `Error 1040: Too many connections`,请适当减小该值。

|

||||

+ `SQL_CONN_MAX_LIFETIME`:连接的最大生命周期,默认为 `60`,单位分钟。

|

||||

- 例子:

|

||||

- MySQL:`SQL_DSN=root:123456@tcp(localhost:3306)/oneapi`

|

||||

- PostgreSQL:`SQL_DSN=postgres://postgres:123456@localhost:5432/oneapi`(适配中,欢迎反馈)

|

||||

- 注意需要提前建立数据库 `oneapi`,无需手动建表,程序将自动建表。

|

||||

- 如果使用本地数据库:部署命令可添加 `--network="host"` 以使得容器内的程序可以访问到宿主机上的 MySQL。

|

||||

- 如果使用云数据库:如果云服务器需要验证身份,需要在连接参数中添加 `?tls=skip-verify`。

|

||||

- 请根据你的数据库配置修改下列参数(或者保持默认值):

|

||||

- `SQL_MAX_IDLE_CONNS`:最大空闲连接数,默认为 `100`。

|

||||

- `SQL_MAX_OPEN_CONNS`:最大打开连接数,默认为 `1000`。

|

||||

- 如果报错 `Error 1040: Too many connections`,请适当减小该值。

|

||||

- `SQL_CONN_MAX_LIFETIME`:连接的最大生命周期,默认为 `60`,单位分钟。

|

||||

4. `FRONTEND_BASE_URL`:设置之后将重定向页面请求到指定的地址,仅限从服务器设置。

|

||||

+ 例子:`FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

- 例子:`FRONTEND_BASE_URL=https://openai.justsong.cn`

|

||||

5. `MEMORY_CACHE_ENABLED`:启用内存缓存,会导致用户额度的更新存在一定的延迟,可选值为 `true` 和 `false`,未设置则默认为 `false`。

|

||||

+ 例子:`MEMORY_CACHE_ENABLED=true`

|

||||

- 例子:`MEMORY_CACHE_ENABLED=true`

|

||||

6. `SYNC_FREQUENCY`:在启用缓存的情况下与数据库同步配置的频率,单位为秒,默认为 `600` 秒。

|

||||

+ 例子:`SYNC_FREQUENCY=60`

|

||||

- 例子:`SYNC_FREQUENCY=60`

|

||||

7. `NODE_TYPE`:设置之后将指定节点类型,可选值为 `master` 和 `slave`,未设置则默认为 `master`。

|

||||

+ 例子:`NODE_TYPE=slave`

|

||||

- 例子:`NODE_TYPE=slave`

|

||||

8. `CHANNEL_UPDATE_FREQUENCY`:设置之后将定期更新渠道余额,单位为分钟,未设置则不进行更新。

|

||||

+ 例子:`CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

- 例子:`CHANNEL_UPDATE_FREQUENCY=1440`

|

||||

9. `CHANNEL_TEST_FREQUENCY`:设置之后将定期检查渠道,单位为分钟,未设置则不进行检查。

|

||||

+ 例子:`CHANNEL_TEST_FREQUENCY=1440`

|

||||

- 例子:`CHANNEL_TEST_FREQUENCY=1440`

|

||||

10. `POLLING_INTERVAL`:批量更新渠道余额以及测试可用性时的请求间隔,单位为秒,默认无间隔。

|

||||

+ 例子:`POLLING_INTERVAL=5`

|

||||

- 例子:`POLLING_INTERVAL=5`

|

||||

11. `BATCH_UPDATE_ENABLED`:启用数据库批量更新聚合,会导致用户额度的更新存在一定的延迟可选值为 `true` 和 `false`,未设置则默认为 `false`。

|

||||

+ 例子:`BATCH_UPDATE_ENABLED=true`

|

||||

+ 如果你遇到了数据库连接数过多的问题,可以尝试启用该选项。

|

||||

- 例子:`BATCH_UPDATE_ENABLED=true`

|

||||

- 如果你遇到了数据库连接数过多的问题,可以尝试启用该选项。

|

||||

12. `BATCH_UPDATE_INTERVAL=5`:批量更新聚合的时间间隔,单位为秒,默认为 `5`。

|

||||

+ 例子:`BATCH_UPDATE_INTERVAL=5`

|

||||

- 例子:`BATCH_UPDATE_INTERVAL=5`

|

||||

13. 请求频率限制:

|

||||

+ `GLOBAL_API_RATE_LIMIT`:全局 API 速率限制(除中继请求外),单 ip 三分钟内的最大请求数,默认为 `180`。

|

||||

+ `GLOBAL_WEB_RATE_LIMIT`:全局 Web 速率限制,单 ip 三分钟内的最大请求数,默认为 `60`。

|

||||

- `GLOBAL_API_RATE_LIMIT`:全局 API 速率限制(除中继请求外),单 ip 三分钟内的最大请求数,默认为 `180`。

|

||||

- `GLOBAL_WEB_RATE_LIMIT`:全局 Web 速率限制,单 ip 三分钟内的最大请求数,默认为 `60`。

|

||||

14. 编码器缓存设置:

|

||||

+ `TIKTOKEN_CACHE_DIR`:默认程序启动时会联网下载一些通用的词元的编码,如:`gpt-3.5-turbo`,在一些网络环境不稳定,或者离线情况,可能会导致启动有问题,可以配置此目录缓存数据,可迁移到离线环境。

|

||||

+ `DATA_GYM_CACHE_DIR`:目前该配置作用与 `TIKTOKEN_CACHE_DIR` 一致,但是优先级没有它高。

|

||||

- `TIKTOKEN_CACHE_DIR`:默认程序启动时会联网下载一些通用的词元的编码,如:`gpt-3.5-turbo`,在一些网络环境不稳定,或者离线情况,可能会导致启动有问题,可以配置此目录缓存数据,可迁移到离线环境。

|

||||

- `DATA_GYM_CACHE_DIR`:目前该配置作用与 `TIKTOKEN_CACHE_DIR` 一致,但是优先级没有它高。

|

||||

15. `RELAY_TIMEOUT`:中继超时设置,单位为秒,默认不设置超时时间。

|

||||

|

||||

### 命令行参数

|

||||

|

||||

1. `--port <port_number>`: 指定服务器监听的端口号,默认为 `3000`。

|

||||

+ 例子:`--port 3000`

|

||||

- 例子:`--port 3000`

|

||||

2. `--log-dir <log_dir>`: 指定日志文件夹,如果没有设置,默认保存至工作目录的 `logs` 文件夹下。

|

||||

+ 例子:`--log-dir ./logs`

|

||||

- 例子:`--log-dir ./logs`

|

||||

3. `--version`: 打印系统版本号并退出。

|

||||

4. `--help`: 查看命令的使用帮助和参数说明。

|

||||

|

||||

## 演示

|

||||

|

||||

### 在线演示

|

||||

|

||||

注意,该演示站不提供对外服务:

|

||||

https://openai.justsong.cn

|

||||

|

||||

### 截图展示

|

||||

|

||||

|

||||

|

||||

|

||||

## 常见问题

|

||||

|

||||

1. 额度是什么?怎么计算的?One API 的额度计算有问题?

|

||||

+ 额度 = 分组倍率 * 模型倍率 * (提示 token 数 + 补全 token 数 * 补全倍率)

|

||||

+ 其中补全倍率对于 GPT3.5 固定为 1.33,GPT4 为 2,与官方保持一致。

|

||||

+ 如果是非流模式,官方接口会返回消耗的总 token,但是你要注意提示和补全的消耗倍率不一样。

|

||||

+ 注意,One API 的默认倍率就是官方倍率,是已经调整过的。

|

||||

- 额度 = 分组倍率 _ 模型倍率 _ (提示 token 数 + 补全 token 数 \* 补全倍率)

|

||||

- 其中补全倍率对于 GPT3.5 固定为 1.33,GPT4 为 2,与官方保持一致。

|

||||

- 如果是非流模式,官方接口会返回消耗的总 token,但是你要注意提示和补全的消耗倍率不一样。

|

||||

- 注意,One API 的默认倍率就是官方倍率,是已经调整过的。

|

||||

2. 账户额度足够为什么提示额度不足?

|

||||

+ 请检查你的令牌额度是否足够,这个和账户额度是分开的。

|

||||

+ 令牌额度仅供用户设置最大使用量,用户可自由设置。

|

||||

- 请检查你的令牌额度是否足够,这个和账户额度是分开的。

|

||||

- 令牌额度仅供用户设置最大使用量,用户可自由设置。

|

||||

3. 提示无可用渠道?

|

||||

+ 请检查的用户分组和渠道分组设置。

|

||||

+ 以及渠道的模型设置。

|

||||

- 请检查的用户分组和渠道分组设置。

|

||||

- 以及渠道的模型设置。

|

||||

4. 渠道测试报错:`invalid character '<' looking for beginning of value`

|

||||

+ 这是因为返回值不是合法的 JSON,而是一个 HTML 页面。

|

||||

+ 大概率是你的部署站的 IP 或代理的节点被 CloudFlare 封禁了。

|

||||

- 这是因为返回值不是合法的 JSON,而是一个 HTML 页面。

|

||||

- 大概率是你的部署站的 IP 或代理的节点被 CloudFlare 封禁了。

|

||||

5. ChatGPT Next Web 报错:`Failed to fetch`

|

||||

+ 部署的时候不要设置 `BASE_URL`。

|

||||

+ 检查你的接口地址和 API Key 有没有填对。

|

||||

+ 检查是否启用了 HTTPS,浏览器会拦截 HTTPS 域名下的 HTTP 请求。

|

||||

- 部署的时候不要设置 `BASE_URL`。

|

||||

- 检查你的接口地址和 API Key 有没有填对。

|

||||

- 检查是否启用了 HTTPS,浏览器会拦截 HTTPS 域名下的 HTTP 请求。

|

||||

6. 报错:`当前分组负载已饱和,请稍后再试`

|

||||

+ 上游通道 429 了。

|

||||

- 上游通道 429 了。

|

||||

7. 升级之后我的数据会丢失吗?

|

||||

+ 如果使用 MySQL,不会。

|

||||

+ 如果使用 SQLite,需要按照我所给的部署命令挂载 volume 持久化 one-api.db 数据库文件,否则容器重启后数据会丢失。

|

||||

- 如果使用 MySQL,不会。

|

||||

- 如果使用 SQLite,需要按照我所给的部署命令挂载 volume 持久化 one-api.db 数据库文件,否则容器重启后数据会丢失。

|

||||

8. 升级之前数据库需要做变更吗?

|

||||

+ 一般情况下不需要,系统将在初始化的时候自动调整。

|

||||

+ 如果需要的话,我会在更新日志中说明,并给出脚本。

|

||||

- 一般情况下不需要,系统将在初始化的时候自动调整。

|

||||

- 如果需要的话,我会在更新日志中说明,并给出脚本。

|

||||

|

||||

## 相关项目

|

||||

* [FastGPT](https://github.com/labring/FastGPT): 基于 LLM 大语言模型的知识库问答系统

|

||||

* [ChatGPT Next Web](https://github.com/Yidadaa/ChatGPT-Next-Web): 一键拥有你自己的跨平台 ChatGPT 应用

|

||||

|

||||

- [FastGPT](https://github.com/labring/FastGPT): 基于 LLM 大语言模型的知识库问答系统

|

||||

- [ChatGPT Next Web](https://github.com/Yidadaa/ChatGPT-Next-Web): 一键拥有你自己的跨平台 ChatGPT 应用

|

||||

|

||||

## 注意

|

||||

|

||||

|

||||

@ -15,14 +15,18 @@ const Footer = () => {

|

||||

<div className="custom-footer" dangerouslySetInnerHTML={{ __html: siteInfo.footer_html }}></div>

|

||||

) : (

|

||||

<>

|

||||

<Link href="https://github.com/songquanpeng/one-api" target="_blank">

|

||||

<Link href="https://github.com/MartialBE/one-api" target="_blank">

|

||||

{siteInfo.system_name} {process.env.REACT_APP_VERSION}{' '}

|

||||

</Link>

|

||||

由{' '}

|

||||

<Link href="https://github.com/songquanpeng" target="_blank">

|

||||

JustSong

|

||||

</Link>{' '}

|

||||

构建,源代码遵循

|

||||

构建,

|

||||

<Link href="https://github.com/MartialBE" target="_blank">

|

||||

MartialBE

|

||||

</Link>

|

||||

修改,源代码遵循

|

||||

<Link href="https://opensource.org/licenses/mit-license.php"> MIT 协议</Link>

|

||||

</>

|

||||

)}

|

||||

|

||||

@ -41,7 +41,7 @@ const About = () => {

|

||||

<Typography variant="body2">

|

||||

可在设置页面设置关于内容,支持 HTML & Markdown <br />

|

||||

项目仓库地址:

|

||||

<a href="https://github.com/songquanpeng/one-api">https://github.com/songquanpeng/one-api</a>

|

||||

<a href="https://github.com/MartialBE/one-api">https://github.com/MartialBE/one-api</a>

|

||||

</Typography>

|

||||

</MainCard>

|

||||

</Container>

|

||||

|

||||

@ -26,7 +26,7 @@ const BaseIndex = () => (

|

||||

<Button

|

||||

variant="contained"

|

||||

startIcon={<GitHub />}

|

||||

href="https://github.com/songquanpeng/one-api"

|

||||

href="https://github.com/MartialBE/one-api"

|

||||

target="_blank"

|

||||

sx={{ backgroundColor: '#24292e', color: '#fff', width: 'fit-content', boxShadow: '0 3px 5px 2px rgba(255, 105, 135, .3)' }}

|

||||

>

|

||||

|

||||

@ -101,11 +101,11 @@ const OtherSetting = () => {

|

||||

};

|

||||

|

||||

const openGitHubRelease = () => {

|

||||

window.location = 'https://github.com/songquanpeng/one-api/releases/latest';

|

||||

window.location = 'https://github.com/MartialBE/one-api/releases/latest';

|

||||

};

|

||||

|

||||

const checkUpdate = async () => {

|

||||

const res = await API.get('https://api.github.com/repos/songquanpeng/one-api/releases/latest');

|

||||

const res = await API.get('https://api.github.com/repos/MartialBE/one-api/releases/latest');

|

||||

const { tag_name, body } = res.data;

|

||||

if (tag_name === process.env.REACT_APP_VERSION) {

|

||||

showSuccess(`已是最新版本:${tag_name}`);

|

||||

|

||||

Loading…

Reference in New Issue

Block a user